从“互喷”到“互吹” , 何小鹏如何让马斯克选择了“尊重”?

7月30号,小鹏汽车举行了AI智能驾驶技术发布会。何小鹏在会上坦言,特斯拉在新能源车领域具有重要影响力,许多中国新兴车企都受到了它的启发。尽管4年前何小鹏与特斯拉有过紧张关系,但现在双方似乎已经缓和,甚至开始互相赞赏。何小鹏亲自体验了特斯拉的FSD,并给予了好评。马斯克也表示,小鹏在智能驾驶领域是中国最具竞争力的制造商。

虽不知为何这两家公司能从“剑拔弩张”走向“商业互吹”,但是不可否认的是,小鹏的智能驾驶技术,确实得到了马斯克的认可。

记得在2014年春天,特斯拉在中国首次交车,Model S成了那些幸运儿的“新事物”,而何小鹏,当时还是UC浏览器的创始人,也拿到了他的那辆。

当时,看着自己的新车,何小鹏心里有点不是滋味,他想,咱们中国怎么就造不出像特斯拉这样的牛车呢?

他可不是光说不练的人,立马行动起来。因此,何小鹏说了句挺有劲儿的话:“创业一轮回,苦辣酸甜咸,归来还是少年”,这句话一出口,就标志着他正式踏上了造车这条路。

因为在他眼里,智能汽车的出现,就像当年功能机变成智能机一样,预示着一个全新的时代即将到来。

所以,小鹏汽车从一开始就把自己定位成科技范儿,不知不觉中,通过不懈的发展,也成了人们口中的“中国版特斯拉”。

而这其中最为代表性的,就是小鹏在智能驾驶方面的发展。

在这场发布会中,小鹏汽车宣布将向全球全量推送AI天玑系统XOS 5.2.0版本,带来覆盖智能驾驶和智能座舱的484项功能升级。通过本次更新,小鹏汽车XNGP(自动导航辅助驾驶)将从“全国都能开”升级为“全国都好用”,实现“不限城市、不限路线、不限路况的”全国全量开放。

其实,对于商家在宣传上,都会将“全国能开”、“不限城市”等等宣传口吻挂在嘴边,但是作为一些用户来说,在实际的体验中却没有想象中的好用,这能说明现在的智驾技术不行吗?

还真不是。

智驾技术的好坏,其实和一家公司从底子到研发上花的心思是分不开的。

就像,你得把一个好厨师比作智驾技术,这家伙得靠长年累月的实战经验来让自己的手艺更上一层楼。

你炒的菜多了,就像智驾车收集的数据多了;你掌握放盐的分量,就和智驾系统算法调得准不准一样。

何况,这个“口味”也会在不断的演变。

那么,最新的“口味”是什么呢?

答案在于端到端的解决方案。这不仅是特斯拉,也是包括小鹏在内的所有汽车制造商所追求的发展方向。

然而,要透彻理解这一概念,我们需要从智能驾驶技术的基础讲起。

三大部分,成就智驾

假如你正走在路上,突然看见前方有一个有一个路口,并且正中央立了个桩子,这是你看了看手机导航后继续往前走,可是就在此时,你听到后方车辆行驶的声音越来越大!那么,你会怎么办?

当然是绕过桩子,转弯继续跟着导航走,并且避开后面的车辆以防被撞倒。这一套看似简单的行动顺序,其实都是经过大脑反复推算而得出的身体反应。

因为当你看到前方有路口有一个桩子挡路时,你的大脑就会告诉你将脚步向边上偏移一点,以最短的路线绕过去。

之后,看一眼手机导航来确定自己的路线和原计划的一样,并且在听到后面车辆行驶声音越来越近后,大脑又像你的双腿发出指令再往边上走走避让一下,而这一整套的动作顺序就是我们现在常提到的自动辅助驾驶。

一般来说,自动辅助驾驶的整个运行逻辑分为三个部分:

感知层、决策层和控制层。

首先,提到自动辅助驾驶就会听到激光雷达、毫米波雷达、超声波雷达、摄像头、惯性制导、高精地图等,而诸如此类就和我们的双眼、耳朵、鼻子一样,统称为感知器件。

它们会在车辆行驶当中,不断地收集数据,比如激光雷达负责收集前方路况结构的点云数据,超声波雷达收集距离与车速数据、摄像头收集路面物体形状数据,定位系统与高精地图则收集位置坐标系信息等数据。当它们被统一过滤整理后,就会发送到决策层了。

到了决策层后,就会将所有的数据与车辆的运动相结合起来分析,比如毫米波雷达发现前车降速了,这时它把信息发给决策层后,决策层就会发布减速命令。

当然在这之中,还有一些小细节需要考虑,比如多少距离内减速、减速的速率多少,转向时机在哪等,因此这些决策需要融合多方面数据才能下定结论,而这也考验了决策层的中枢大脑——芯片。

你是否够聪明要考验你脑子的反应理解的速度,自动辅助驾驶也是如此。

芯片的算力是整个决策层对于路况判断快慢的重要标准,算力越大自动辅助驾驶的能力越高,反之则越“不聪明”。

最后,控制层就要执行决策层下达的任务。如果决策层下达“车辆减速”命令,那控制层就会调节车辆的制动器力度,来实现车辆的降速等动作。

当然,这些只是智能驾驶领域的基础模型。要通过技术手段实现这三个关键步骤,其中蕴含着深厚的学问。

因为这三个层面的每一层还可以划分为不同的模块,每个模块还可以划分为不同的子模块,这就像俄罗斯套娃一样。这得靠程序员写代码,告诉车怎么走。

不过,这么搞有两个大问题,首先信息得一层层传,每传一次就可能丢点东西或者出错,错的东西还会影响下一层,到最后可能就乱了套。

并且系统太复杂,得设计一大堆小部分,而且越往后越难搞。就像你已经搞定了大部分,但剩下的一点点可能要花上你好几倍的力气。

所以简单来说,就是开始的时候进步快,但越到后面越费劲,可能大部分时间都在磨那最后一小撮问题。

那么该如何去解决?“端到端”智驾路线便是个答案。

三大智驾模块,让小鹏走向“端到端”

说到端到端智驾,这个近年来在汽车界引起热议的词汇,确实火得一塌糊涂。它就像是给自动驾驶车辆装上了一个超级大脑。这个大脑能从看到的第一个画面开始,一直到做出驾驶决策,一气呵成,不需要像以前那样分成好几个步骤,每个步骤还要单独处理。

这样一来,车辆的"思考"过程就更加直接和快速,减少了信息在传递过程中的损失,让车辆的反应更加敏捷,升级变化也更迅速。

不过,虽然大家都在谈论端到端智驾,但每家公司对它的理解和实现方式却各有千秋。

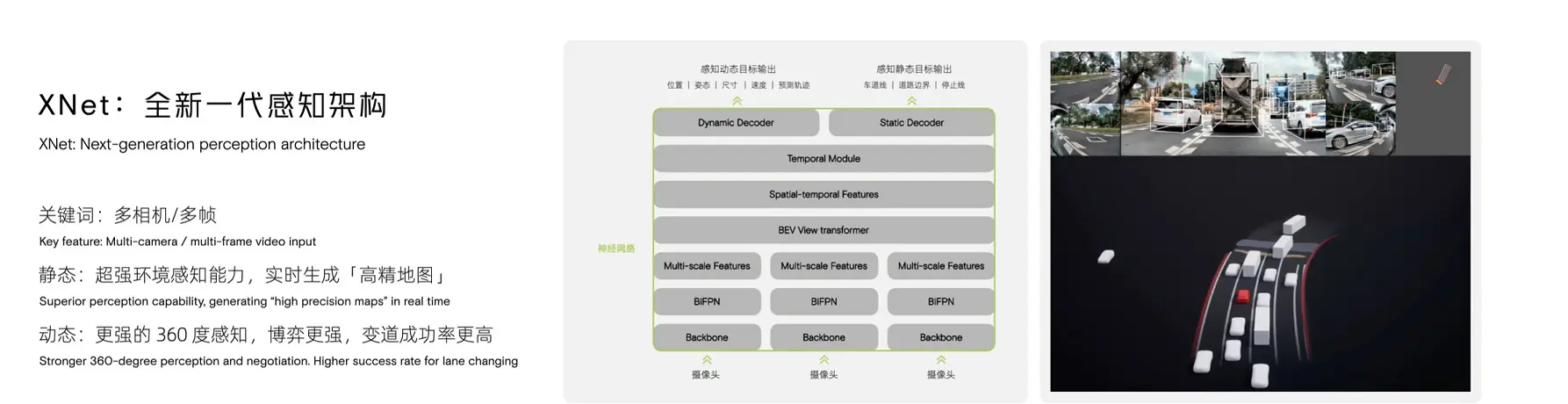

在此次发布会上,小鹏推出国内首个量产的端到端智驾大模型——神经网络XNet+规控大模型XPlanner+大语言模型XBrain,成为全球唯二实现端到端大模型量产落地的车企。

按照何小鹏说,他们已经花掉了35亿人民币在人工智能训练上。有了这种全方位的支持,他们的智能驾驶技术进步得非常快,甚至在短短70天内就发布了5次大的更新,包括35个不同的版本。

他们预计在今年最后一个季度,小鹏汽车的智能驾驶技术将完全实现“端到端”的整合。对用户来说,就是直接用上“门到门”的智驾。

那么问题来了,神经网络XNet、规控大模型XPlanner和大语言模型XBrain,小鹏是如何依靠这三个“模型”来实现“端到端”的?

所以我们就将这一套流程拆开了讲,这样也就让您好理解。

首先,从神经网络XNet说起。

时间回到2018年,当时小鹏G3的推出可以说在市场上引起了不小的轰动。

因为作为小鹏汽车的第一款量产车,G3以"年轻人的第一台智能汽车"为口号,凭借其互联网特色和纯电动SUV的身份,迅速赢得了消费者的目光。

这款车在当时被写了三个关键词:

智能、实惠、创新。

特别是小鹏G3的智驾功能,其XPILOT 2.0自动驾驶辅助和自动泊车,让它在众多新兴汽车品牌中脱颖而出,甚至有人把它比作电动车界的"小米"

要知道,那个时候智驾还是期初阶段时,小鹏XPILOT 2.0自动驾驶辅助就采用了小鹏的XNet模型,也就是深度视觉感知神经网络,这在当时可以说非常超前了。

那什么是XNet深度视觉感知神经网络模型呢?

该模型主要负责从车辆的传感器获取的原始数据中提取特征,实现对车辆周围环境的感知。 它能够识别和理解道路情况、交通标志、其他车辆、行人等,为智能驾驶系统提供必要的环境信息。

这套视觉算法在工作流程方面,简单话说就是用很多摄像头来收集周围环境的情报。而这些摄像头就像是它的眼睛,不停地记录下周围发生的一切。XNet把这些视频流,也就是摄像头捕捉到的画面,直接送到一个非常智能的大模型里去分析。

首先,每张图像都会被XNet的大脑中的两个重要部分处理:一个是网络骨干,它负责提取图像的基本特征;另一个是网络颈部,也就是BiFPN网络,它进一步细化这些特征,让XNet能够看到更多的细节。

最关键的是,这些特征会被XNet的大脑中的一个特殊部件——BEV视图转换器处理,也就是BEV+Transformer。

首先,BEV,就是鸟瞰图,它是一种算法,能把多个传感器收集的图像信息放到一个三维空间里,然后让一个大模型来分析。

跟普通的摄像头拍的照片比起来,BEV提供了一个更接近真实世界的视角,让后续的传感器数据整合和控制模块的开发变得更简单,可能性也更多。

具体来说,BEV的好处有:

1.它把不同来源的数据统一到了三维视角,比如多个摄像头或雷达的数据,这样就能减少误差,给后面的预测和控制模块提供更多有用的信息;

2.它能让时间序列的信息融合在一起,三维视角能减少因为遮挡或尺度问题造成的困扰,有时候还能用已知的信息来补充那些被挡住的部分,提高自动驾驶的安全性;

3.感知和预测可以在同一个三维空间里完成,通过神经网络直接优化,减少了传统方法中感知和预测分开做时可能出现的误差累积。

这样,系统就可以通过视觉的画面获得更多的信息来进行下一步的预测。

来到Transformer这个模型,它的注意力机制可以帮助把二维的图像数据转换成三维的BEV空间。

这个模型最早是Google在2017年为了机器翻译搞出来的,后来技术发展了,它也进入了图像视觉领域,现在在图像分类、检测和分割这些问题上都做得很好。

传统的CNN模型是通过卷积层来筛选图像中的元素,但随着数据量的增加,CNN的效率提升会越来越少。

等等,这里突然冒出了CNN模型,说白了,它就是人工智能里的一个图像识别高手。

CNN模型共分为三个层级,首先是卷积层:这招就像是拿着一堆小放大镜在图片上扫来扫去,专门找那些小细节,比如图片里的边边角角、颜色斑点之类的。

之后就是池化层:这招就像是用个大筛子,把卷积层找到的太多信息过滤一下,只留下最关键的,比如物体的大概轮廓。

最后就是全连接层:就是将这些信息就送到大脑里,这里的神经元会综合判断,告诉我们这张图片里到底是啥,比如是不是一只猫或者一辆车。

言归正传,而Transformer的结构借鉴了人脑的注意力机制,只关注关键信息,就像你看书时只关注重点一样。这样就提高了效率,特别适合处理大量数据。

所以看,在自动驾驶这个领域,Transformer比CNN更能处理复杂的序列和全局信息,现在它已经广泛应用于把二维图像转换成三维空间了。

如果以上让您听着有些懵圈的话,那咱们就这样理解。

首先车辆的周边的摄像头分别记录了车辆周围的如,车前、车两侧、车后的实时画面。而这是,车辆的前摄像头和右侧的摄像头看到了一个物体,而左后边摄像头和后方摄像头并没有记录到,因此系统就会认为在车辆的右前方有一个物体。

之后,在经过系统的比对,发现这个物体是一台汽车,并且通过摄像头记录的这台车在每一帧画面中像素比例的不断变化,并通过毫米波雷达在进一步的加持验证,这样就可以很好的判断出该车辆与本车之间的大致距离,并作进一步的决策处理了。

以上就是对于XNet这种视觉算法的大致理解,或许不太全面或者严谨,但是大致意思就是这样。

通过这些步骤,XNet能够非常清楚地知道周围环境中的动态目标物,比如车辆、自行车等的大小、距离、位置、速度,甚至还能预测它们的行为。同时,它也能准确地识别出静态目标物,比如车道线和马路边缘的位置。

这样,XNet就能帮助我们更好地理解和预测周围的世界了,并最终计算出一条最佳线路行驶。

值得一提的是,再后来小鹏的XNet还引入了占用网络(Occupancy Network),就是是给道路和周围的环境做了一个数字化的"点名册",把道路和周围的空间分成一个个小格子,每个小格子代表一个位置,然后智能系统会判断这些小格子里是不是有东西,比如车、行人或者其他障碍物。

也就是说,占用网络就像堆“乐高积木”一样,是一个高级版的"格子地图",它能帮助自动驾驶汽车更好地理解周围环境,而且这个方块网格越小,精度就越高,以此做出更安全、更智能的驾驶决策。

值得一提的是,小鹏在今年5月举办的AI DAY上,发布了行业首个量产的2K纯视觉占用网络技术。这项技术能够用超过200万个网格重构世界,对现实世界中的可通行空间进行3D高真实度还原,清晰识别静态障碍物的每一个细节,从而提高自动驾驶的安全性和准确性。

下面再来说规控大模型XPlanner

规控大模型XPlanner,作为小鹏汽车在智能驾驶领域的杰出创新,堪称一项非凡的技术成就。

简而言之,它就是给自动驾驶汽车装了个超级大脑,利用先进的神经网络技术,精准规划并控制车辆的行驶路径。这个智能系统展现出卓越的智慧,能够即时洞察周围环境及周围车辆的动态,迅速计算出最为安全且高效的行驶路线。

XPlanner之所以能够实现这一壮举,首先归功于其深厚的“驾驶经验积累”。

通过海量数据的训练与学习,使它能够拥有老司机的敏锐直觉与娴熟技巧。

可使得前后顿挫减少50%、违停卡死减少40%、安全接管减少60%,让用户舒适性、安全性体验都再上新台阶。这样也就能够确保驾驶过程平稳流畅,避免了不必要的急加速、急刹车以及错误的停车位置,极大地减少了人工干预的需求。

此外,XPlanner还具备超凡的环境感知能力。它的“视野”极为开阔且敏锐,无论是动态变化的交通流,还是静态的道路设施与标志,都能被其精准捕捉并综合分析。所以这种全面的环境理解能力,使得XPlanner能够在复杂多变的道路环境中游刃有余,始终为自动驾驶车辆指引出最佳的前进道路。

还有就是,在城市交通的复杂网络中,XPlanner更是展现出了非凡的应变能力。

它能够灵活应对各种突发情况,确保自动驾驶车辆在城市道路上也能保持稳健的行驶状态。而在高速公路等结构化道路上,XPlanner同样表现出色,能够轻松实现自动变道、超车等高级驾驶操作。

尤为值得一提的是,XPlanner还具备强大的自我学习与优化能力。面对不断变化的驾驶场景与新的挑战,它能够不断积累新的经验,持续提升自身的智能水平。这种持续进化的特性,使得XPlanner能够迅速适应各种新环境,为自动驾驶技术的发展注入源源不断的动力。

最后就是AI大语言模型XBrain了。

虽然这项技术的具体细节没有公开太多,但可以肯定的是,它的基本原理和现在挺火的ChatGPT是一脉相承的,都是采用深度学习的算法,特别是那种基于Transformer架构的大块头语言模型。

而这种模型就像是个超级学霸,它通过学习一大堆的文本资料,学会了怎么理解人类的语言,还能写出像模像样的文章来。

并且,它们特别擅长理解语言,不管是复杂的语句结构还是深层的意思,它们都能搞得明明白白,这样一来,它们就能处理很多跟语言有关的任务。

因此,基于此它就能让智能驾驶辅助系统不光能“看到”路上的东西,还能“想明白”这些东西是啥意思。比如能认出待转区、潮汐车道这些复杂的路况,还能看懂路牌上的字,知道啥时候该快、啥时候该慢、啥时候得换道。

就像咱们开车时,看到“前方道路施工,请换道”的牌子,立马就明白要怎么做一样,XBrain也能秒懂这些指令,然后指挥自动驾驶的车子做出既安全又合适的决定。

这样一来,自动驾驶的车子开起来就更像人了,既聪明又可靠。

另外,何小鹏说,小鹏汽车现在搞的这个“端到端智驾大模型”,更新速度特别快,快到每两天就能更新一次。而且,在未来一年半的时间里,这个模型的能力会翻上30倍,这可真是个不小的进步。

所以说这种技术的优势就在于,只要有稳定、大量的好数据,它就能像火箭一样快速进步。

小鹏汽车这次发布的这个“端到端智驾大模型”,确实解决了很多之前模块化智能驾驶会遇到的问题。它减少了需要的模块数量,也不再需要用那种一个一个试的方法来写代码,而是把AI大模型整合到了智能驾驶系统中,这样一来,智能驾驶的能力提升得就更快了。

不过,我们也得看清楚,小鹏这次发布的这个模型,虽然叫“端到端”,但实际上还是分成了几个大模块,通过“三网融合”的技术来实现整体功能的。因此说实话它实际上用起来,它并不是那种纯纯粹粹的“端到端”。

从“能用”到“好用”, 小鹏“端到端”要走多远?

记得在发布会的前夕,何小鹏亲自去美国出了个差,而或许就是这一趟,让他更相下定决心去做“端到端”的智能驾驶。

根据何小鹏的微博动向来看,让先在加州试驾了特斯拉最新的FSD系统,还跟另一家智能驾驶高手Waymo的车比了比。

他发现,特斯拉的FSD在高速和硅谷那些地方跑得特溜,分数高得吓人。而Waymo呢,在旧金山那种复杂的城里头,开起来那叫一个顺畅,坐着都舒服。

不过,何小鹏心里有数,特斯拉这智驾技术的发展速度,到2025年它的FSD怕是要把Waymo甩在后面了。而Waymo之所以现在这么稳,是因为它背后有套超牛的感知、决策、执行系统,跟华为似的,用一大堆工程师去琢磨路上的各种情况。

但特斯拉的FSD也有它的绝招,就是它那个“从头到尾一口气干完”的大模型方案,比那种分块块处理的方式要高明多了,信息传递基本不走样。

当然,要做到这点,得有三个条件:第一,得有大把的数据积累,车得一直开,一直学;第二,数据得对得齐,处理起来得井井有条;第三,得舍得砸钱搞研发,特斯拉为了这个已经花了上百亿美金了。

何小鹏一看,嘿,小鹏汽车在这方面也挺有料的嘛!咱们已经攒了756万公里的智能驾驶数据,还学会了怎么用AI来搞定这些问题。

接着,何小鹏还特意去拜访了英伟达的黄仁勋大佬,跟他聊了聊大模型的算力问题。

英伟达就不必多介绍了,在智能驾驶领域有着举足轻重的地位。,从芯片到软件,再到测试和训练,全包了。并且他们还一直砸钱研发,搞出了好几个厉害的产品,如DRIVE PX、Xavier芯片和AGX Orin平台,这些产品在计算、省电和性能上都特别强。

而且,英伟达还跟比亚迪、蔚来这些车厂合作,把技术用在了真车上,让它在自动驾驶这行当里的地位更稳了。

此外,除了试驾和拜访,何小鹏还参加了美国的AI大会,发现现在投资圈都盯着AI呢,好多互联网公司和软件公司都在往这边转。因此他认为AI这波浪潮至少要引领全球经济十年甚至更久。特别是在AI这片热土上,芯片、大模型、SAAS、视频、无人驾驶、机器人啥的都是热门货,机会多多。

不过,让他有点意外的是,会上没见着几个中国企业家。

所以总的来说,何小鹏这两周美国行,算是把智能驾驶和AI的底细摸了个透。特别是美国那边在智能驾驶大模型上转型的决心和毅力,是小鹏汽车得好好学习的。这些经历也让小鹏汽车更加坚定了自己的智能驾驶战略,还找到了未来怎么跟着AI发展的大方向。

那么,小鹏汽车“端到端”技术的出现,能为小鹏XNGP带来多少的加持了?

这么说吧,何小鹏就已经放话了,从7月31日开始,小鹏XNGP要从“全国都能开”升级到“全国都好用”。并且他还提前透露了个更大的目标,就是将来要让小鹏XNGP“全球都好用”,不过现在说这个还有点早。

别看这三句话短,这里面的道道可深了。俗话说得好“字越少,事越大!”

小鹏汽车他们说的“全国都好开”,其实就是三个意思:不管在哪个城市,不管走哪条路,不管路好不好走,小鹏XNGP都能搞定。

先说说“不限城市”这个事,小鹏他们用了一种挺实在的办法,就是让工程师们亲自去跑。他们去了全国2595个城市,开着车跑了756万公里。这么干虽然费时费力,但是能收集到很多路上的真实情况,让XNGP智能驾驶在各种路上都能稳稳当当。

今年6月,小鹏的智驾老大李力耘在网上说过,小鹏的智驾要换成“黑名单”模式。现在看来,他们这么有信心,是因为真的跑遍了国内的每个角落,知道哪些路现在还搞不定,其他的路就可以放心大胆地开。

再说说“不限路线”,小鹏计划今年晚点推出个“门到门”智驾系统,何小鹏说连工厂里头的路、收费站、ETC都能自己搞定,从家里出门到办公室进门,这一路上都可以放心交给智驾。

至于“不限路况”,何小鹏举了个“环岛”这种复杂路况的例子,说最后还是得靠“端到端”技术。小鹏XNGP里头的XBrain模块能读懂路,提前想好怎么走,不管是过环岛还是掉头,都能找到好办法。

按照小鹏的计划,现在XNGP要开始“全国都好用”的第一步,年底推出“门到门”智驾后就是第二步,到了2025年,小鹏智驾还要上个新台阶。

何小鹏希望智驾能从“好用”变得“让人爱用”,成为新能源车的一个大亮点。

这里还有一个值得一提的事。

不久前有外媒爆料,小鹏将在今年晚些时候推出一款新车型,代号F57,而它也就是大家心心念念的P7+,并且这款新车不打算用激光雷达了。这事儿一出来,大家都挺震惊的,因为这意味着小鹏汽车彻底告别了之前P7那种双激光雷达的配置,全面拥抱了纯视觉技术。

就连一向有啥说啥的马斯克,这次在社交媒体上也只是发了三个点“...”,看来他也有点意外。

不过话说回来,马斯克一直都觉得激光雷达太贵,用不上,他一直主张用纯视觉技术来搞自动驾驶。特别是何小鹏在美国体验完特斯拉的FSD V12后,觉得挺不错,还说小鹏得从特斯拉那儿学学人家的好功能和用户体验。

所以,小鹏这次不玩激光雷达了,这事儿也不难理解。

有人说,这可能会带动一波跟风潮,其他车厂可能也会跟着走这条路。不过,也有人觉得小鹏这一变,对整个行业来说可能是个大震动。

但是可以肯定的是,决定不再依赖激光雷达,这可不是一时冲动,而是经过了深思熟虑的战略调整。

就拿F57这款车来说,虽然早期的视频中它还装备着两个激光雷达,但小鹏的计划是在量产时将它们剔除。

有媒体透露,F57是在吴新宙还在任时确定的车型,作为一位视觉技术的坚定支持者,他可能从一开始就没打算让这款车搭载激光雷达。目前测试车上的激光雷达,可能仅仅是为了进行一些对比测试。

顺便一提,8月8日已经开始预售的MONA M03也没有激光雷达的版本。

不过有意思的是,就在4月底,速腾聚创和小鹏汽车宣布了一项合作,计划使用速腾聚创的MX激光雷达为小鹏车型提供升级。但有行业观察家猜测,可能只有旗舰车型才会享受到激光雷达的待遇。

回顾过去两年,速腾聚创的M平台激光雷达已经广泛应用于小鹏的P7i、G6、G9、X9等多款车型。然而,如果F57真的放弃激光雷达,据说将转而采用3D毫米波雷达。虽然3D毫米波雷达的成本大约只有200元,但与4D毫米波雷达相比,它的价值就显得不那么显著了。

当然,小鹏汽车的董事长何小鹏,对于激光雷达一直持有保留态度。早在2021年小鹏P5上市时,他就明确表示过,不认为激光雷达是智能汽车的必备杀手锏。但说到底,放弃激光雷达的决定主要是基于成本的考量。

何小鹏在2024年第一季度的财报电话会议上明确表示,他们计划在第四季度推出一款全新的B级纯电轿车,目标是实现成本降低25%。这表明小鹏汽车在追求技术创新的同时,也在积极寻求成本效益的平衡。

写在最后

可以说今年,小鹏汽车真的是大刀阔斧地推广他们的智能化技术。不仅想让每个人都知道他们的智能技术有多厉害,还想向那些商业伙伴展示它们的实力。虽然小鹏在研发上的投入排名不是最靠前,但其智能化技术的实力却非常出色,投入产出比高得惊人,简直是行业的标杆。

不可否认的是,从全世界来看中国的自动驾驶技术现在仅次于美国,而像小鹏和华为这些企业正在一起努力让这项技术更上一层楼。特别是"端到端智驾大模型"这种技术一旦广泛应用,中国的自动驾驶技术肯定会有大的突破。

虽然小鹏在销售上遇到了一些困难,但何小鹏作为公司的领头人,他还是很有信心的。

他认为技术是公司最重要的东西,强调要集中精力提升人工智能技术,为智能汽车的未来发展打下好的基础。所以,何小鹏期待着一个智能驾驶技术非常发达的未来,而我们也有理由相信,小鹏汽车则将带领中国汽车行业在激烈的市场竞争中找到新的方向。